差分进化(Differential Evolution, DE)作为演化计算的核心算法之一,因其简单高效而被广泛应用于黑盒优化问题。然而,其性能在很大程度上依赖于超参数和策略的选择,这一直是研究人员面临的一个难题。为了解决这一挑战,EvoX 团队最近在 IEEE Transactions on Evolutionary Computation (IEEE TEVC) 上发表了一项题为“MetaDE: Evolving Differential Evolution by Differential Evolution”(MetaDE:通过差分进化演化差分进化)的研究。作为一种利用 DE 来演化自身超参数和策略的元演化方法,MetaDE 能够在结合 GPU 加速并行计算的同时,动态调整参数和策略。这种设计在大幅提高计算效率的同时,也显著提升了优化性能。实验结果表明,MetaDE 在 CEC2022 基准测试集和机器人控制任务上均表现出色。MetaDE 的源代码已在 GitHub 上开源:https://github.com/EMI-Group/metade。

背景

在演化计算领域,算法的性能往往受到超参数选择的显著影响。确定针对特定问题的最合适参数设置一直是一个长期的研究挑战。差分进化(DE)作为一种经典的演化算法,因其简单性和强大的全局搜索能力而广受青睐;然而,其性能对超参数的选择高度敏感。传统方法通常依赖于基于经验的调优或自适应机制来提高性能。但是,面对多样化的问题场景,这些方法往往难以在效率和广泛适用性之间取得平衡。

“元演化”(Meta-Evolution)的概念早在上个世纪就已被提出,旨在利用演化算法本身来优化这些算法的超参数配置。虽然元演化已存在多年,但其实际应用一直受到高计算需求的限制。GPU 计算的最新进展缓解了这些限制,为演化算法提供了强大的硬件支持。特别是分布式 GPU 加速 EvoX 框架的推出,极大地促进了基于 GPU 的演化算法的发展。在此背景下,我们的研究团队提出了一种新颖的元演化方法,利用 DE 来演化其自身的超参数和策略,从而为解决演化算法中长期存在的参数调优问题提供了一条新途径。

什么是元演化?

元演化的核心思想可以概括为“用演化算法演化自身”(Evolving an Evolutionary Algorithm by an Evolutionary Algorithm)。这一概念超越了传统的演化计算方法,不仅利用演化算法搜索问题的最优解,还通过自身的演化过程自适应地调整算法的超参数和策略。

换句话说,元演化引入了一种“自演化”范式,使算法能够在探索问题解空间的搜索过程中优化自身。通过在演化过程中不断自我完善,算法变得更具适应性,并能在各种问题场景中保持高效率。

以 MetaDE 为例,其设计正是植根于这一理念。在一个双层结构中,下层(“执行器”,executor)使用参数化的 DE 解决给定的优化问题。上层(“演化器”,evolver)同时使用 DE 来优化执行器的超参数配置。这个框架让 DE 不仅作为一个求解器,还能“探索”如何最好地调整自身的参数和策略,以更有效地解决不同问题。这一过程类似于一个系统逐步理解和完善自身——从**“被动解决问题”转变为“主动自我演化”**。因此,它可以更好地适应多样化的任务。如果我们把 DE 看作一个复杂的系统,MetaDE 实际上在该系统内实现了一种“递归”式的自我理解和自我提升。

计算机科学中的术语“递归”通常描述一个调用自身的函数或过程。在 MetaDE 中,这个概念有了新的含义:它是一种内部递归优化机制,利用 DE 来演化 DE 的超参数。这种自指(self-referential)方案不仅体现了强大的自适应性,也为“没有免费午餐”定理提供了一个新的视角。因为不存在一套适用于所有问题的通用最优参数,允许算法自主演化自身是找到针对特定任务的最佳参数配置的关键。

通过这种递归元演化方法,MetaDE 实现了以下几个优势:

1. 自动化参数调优

消除了劳动密集型的人工调优过程。算法自身学习如何调整其超参数,减少了人工干预并提高了效率。2. 增强的适应性

MetaDE 能够动态响应不断变化的问题特征和条件,实时修改策略以提高性能。这显著增加了算法的灵活性。3. 高效搜索 利用固有的并行性,MetaDE 极大地加速了大规模优化问题的搜索。它能在合理的时间范围内为高维、复杂问题提供可行的解决方案。

算法实现

MetaDE 采用基于张量的技术和 GPU 加速来实现高效的并行计算。通过同时处理种群中的许多个体,整体计算效率得到显著提高,这在单目标黑盒优化和大规模优化问题中尤为有利。通过对关键参数和数据结构(如种群、适应度、策略参数)进行张量化,MetaDE 不仅实现了更高的计算效率,还增强了其应对复杂优化挑战的能力。与经典 DE 和其他演化算法(EAs)相比,MetaDE 在解决大规模问题时表现出卓越的性能。得益于基于张量的方法,MetaDE 能更有效地利用计算资源,产生比传统方法更快的解决方案和更精确的优化结果。

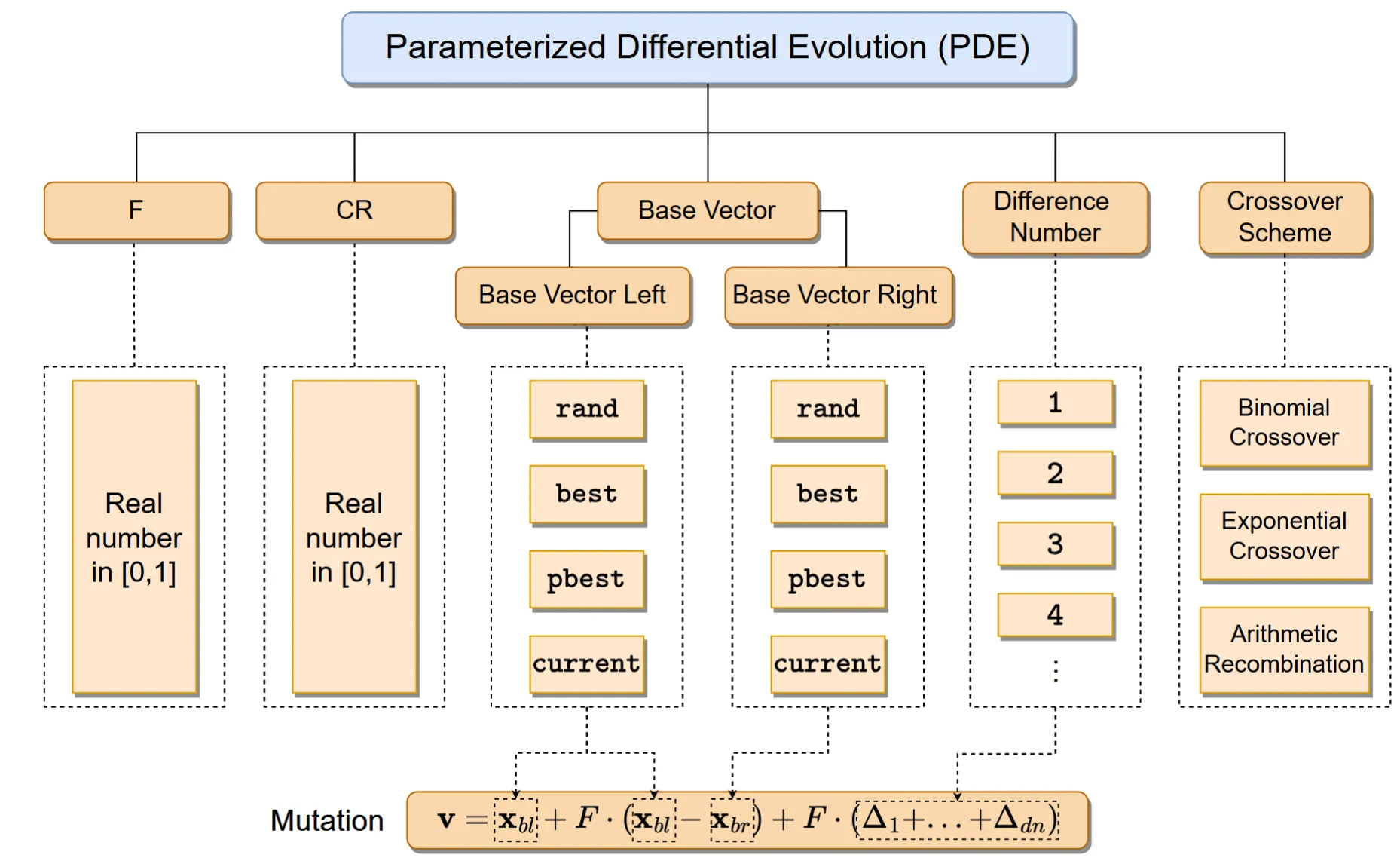

PDE 架构

研究团队首先提出了一个完全支持参数和策略修改的参数化 DE 算法框架(PDE)。在这个框架中,F 和 CR 是连续参数,而其他参数是离散的。虚线框表示允许的参数值范围。变异函数源自左右基向量,以及控制差分向量数量的参数。

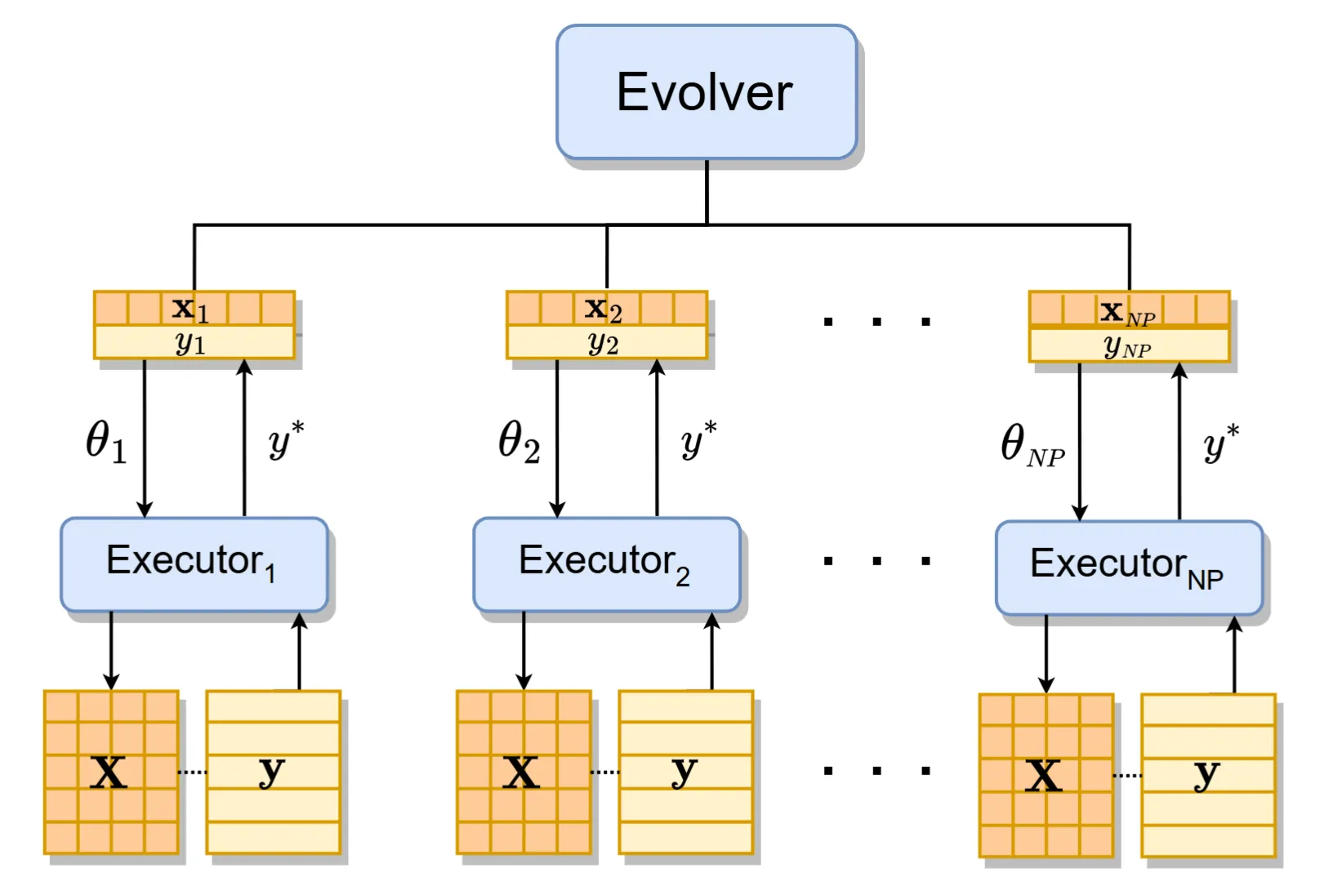

MetaDE 架构

MetaDE 采用双层结构,包含一个演化器(上层)和多个执行器(下层)。演化器是一个 DE(或者是其他演化算法),负责优化 PDE 的参数。演化器种群中的每个个体 ![]() x_i 对应一个唯一的参数配置 θ_i。这些配置被传递给 PDE 以实例化不同的 DE 变体,每个变体由一个执行器管理,并在给定的优化任务上独立运行。每个执行器将其最佳适应度值 y^* 返回给演化器,演化器将该适应度值 y_i 分配给相应的个体 x_i。

x_i 对应一个唯一的参数配置 θ_i。这些配置被传递给 PDE 以实例化不同的 DE 变体,每个变体由一个执行器管理,并在给定的优化任务上独立运行。每个执行器将其最佳适应度值 y^* 返回给演化器,演化器将该适应度值 y_i 分配给相应的个体 x_i。

实验性能

为了全面评估 MetaDE 的有效性,研究团队在多个基准测试和现实场景中进行了系统实验。每个实验都使用了一个演化器(采用 rand/1/bin 策略的 DE)和多个执行器(种群大小为 100 的 PDE)。关键实验部分包括:

CEC2022 基准测试

在单目标优化任务中将 MetaDE 与各种 DE 变体进行比较。

与 CEC2022 前四名算法的比较

在相同的函数评估次数(FEs)预算下,评估 MetaDE 与 CEC2022 竞赛中表现最好的四种算法的性能。

固定物理时间下的函数评估次数(FEs)

分析 MetaDE 在 GPU 加速下的计算效率。

机器人控制任务

将 MetaDE 应用于 Brax 平台环境中的机器人控制任务,以验证其实际效用。

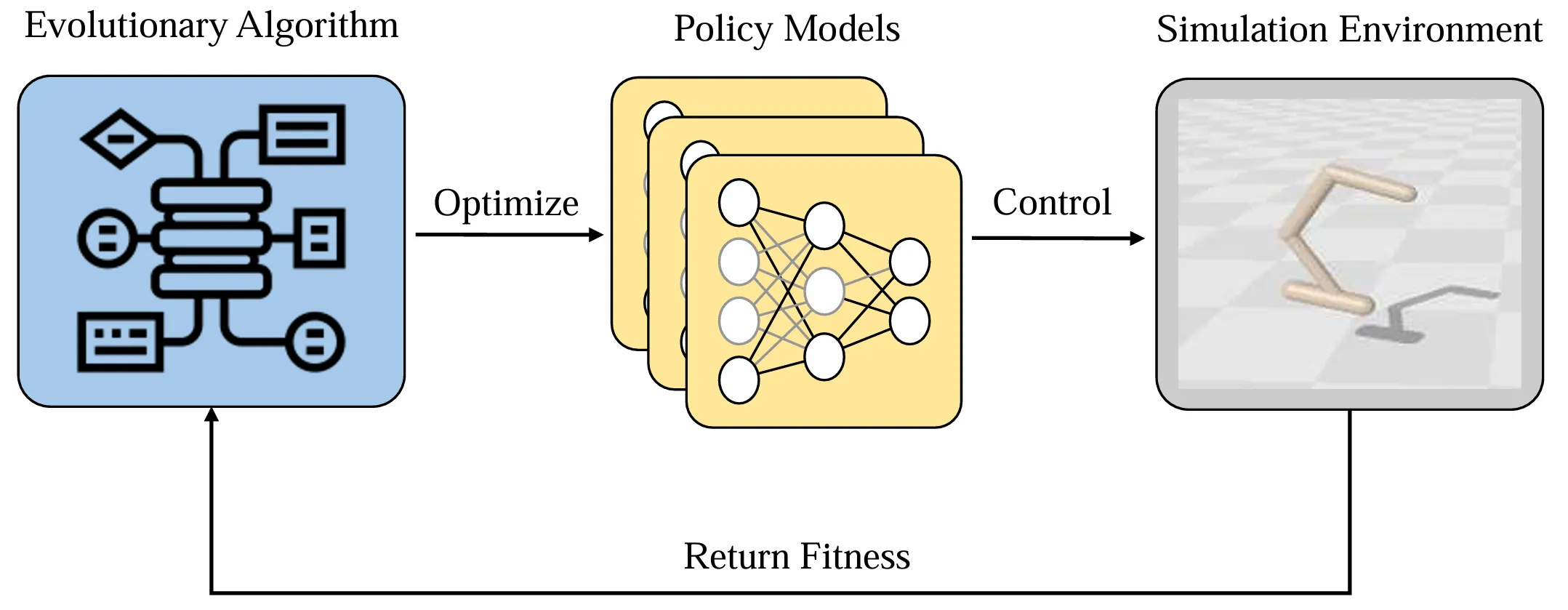

CEC2022 基准测试:与主流 DE 变体的比较

团队在 CEC2022 基准测试集上将 MetaDE 与几种具有代表性的 DE 变体进行了比较,包括:

- 标准 DE (rand/1/bin)

- SaDE 和 JaDE (自适应 DE 算法)

- CoDE (策略集成 DE)

- SHADE 和 LSHADE-RSP (基于成功历史的自适应 DE)

- EDEV (集成 DE 变体)

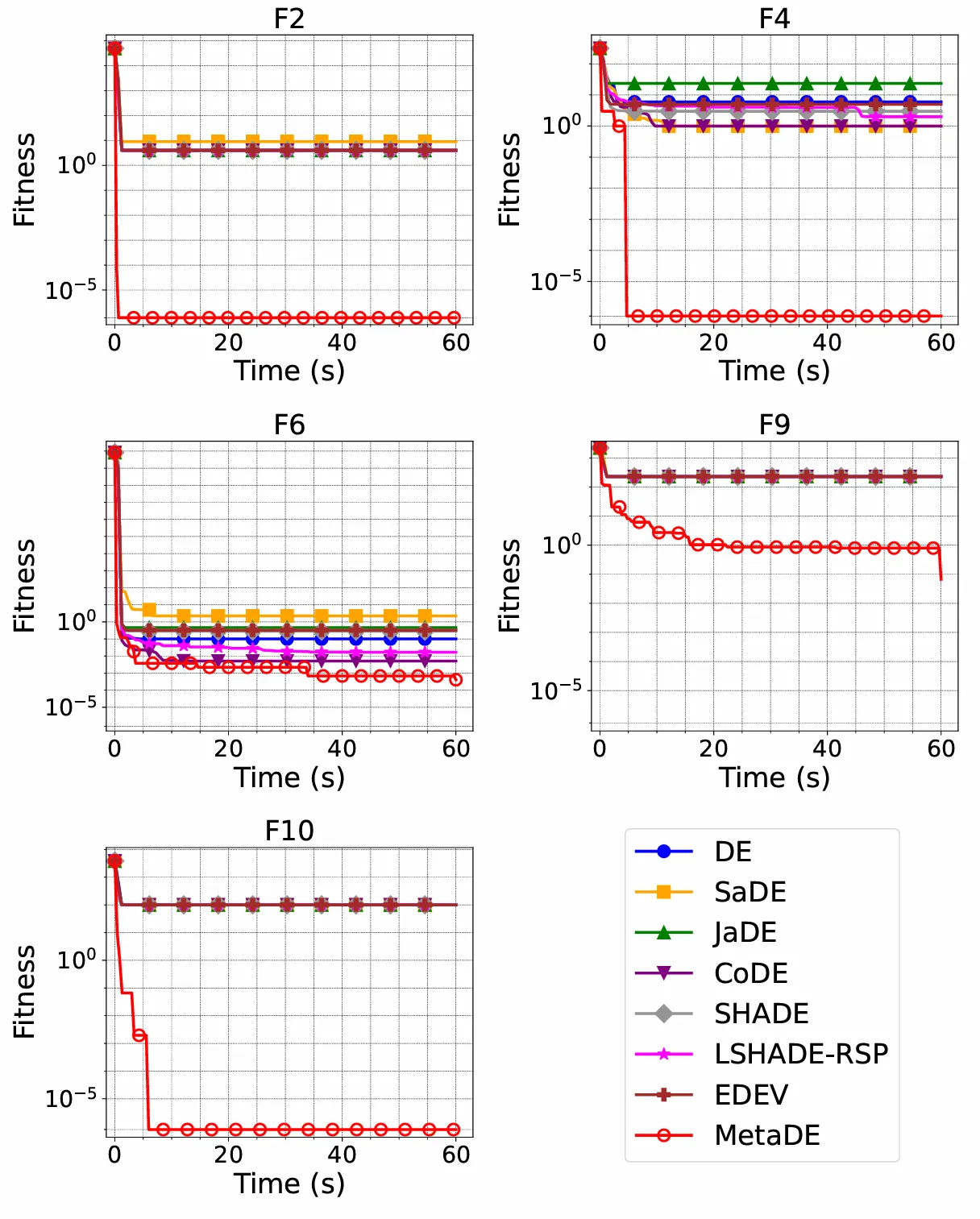

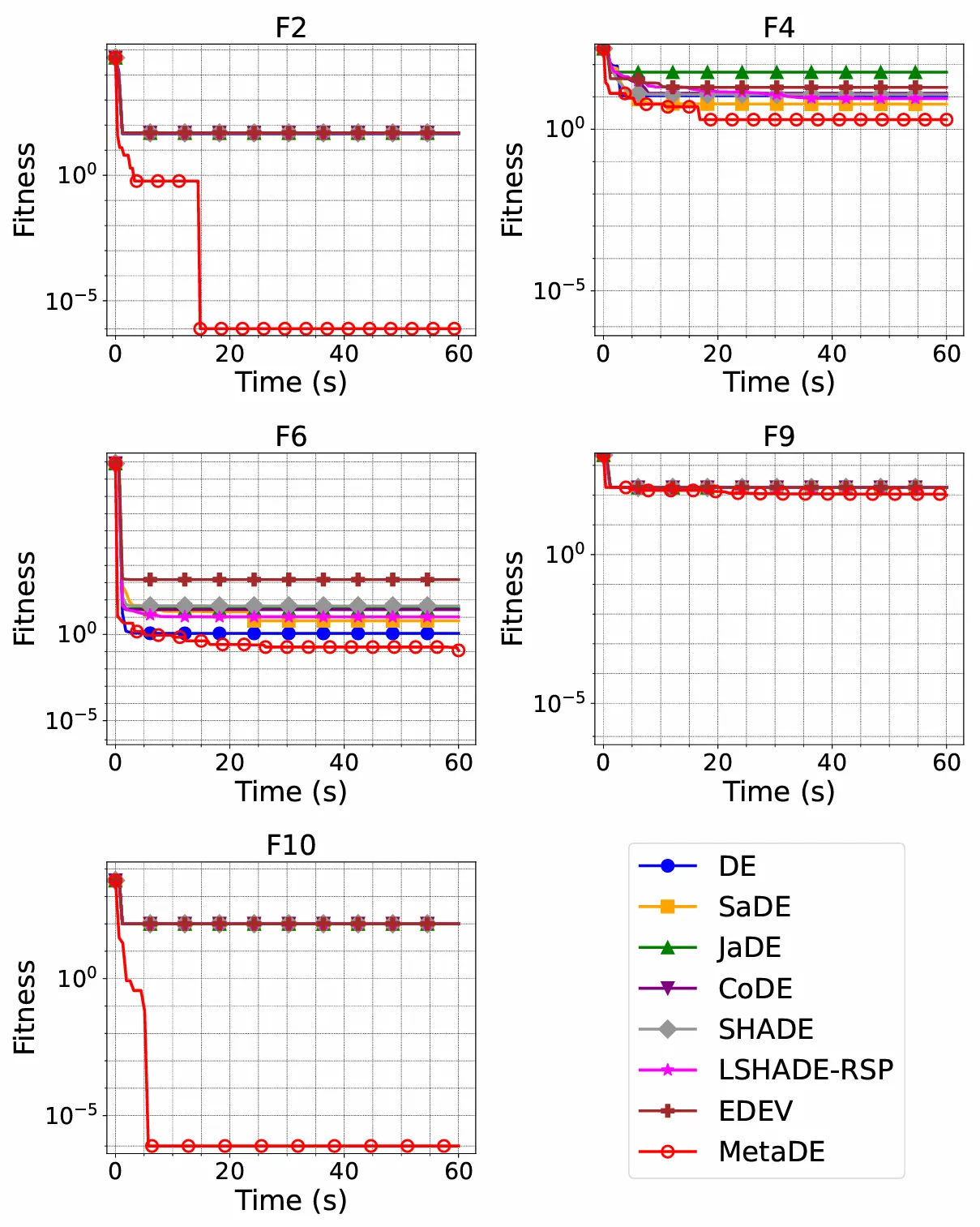

所有算法均在 EvoX 平台上实现,利用 GPU 加速,且为了公平起见,种群大小均为 100。实验在不同维度(10D 和 20D)下进行,并受到相同的计算时间限制(60 秒)。

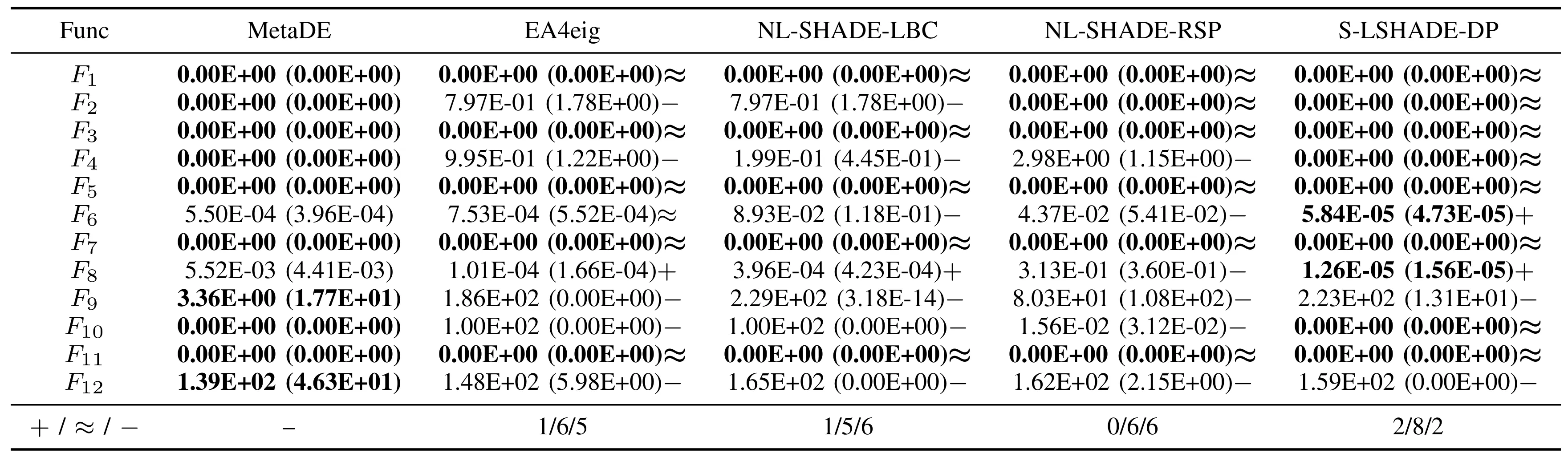

10D CEC2022 优化结果

20D CEC2022 优化结果

MetaDE 在大多数测试函数上通常能实现更快速和稳定的收敛。其参数化 DE(PDE)结合上层优化,使其能够动态适应不同的问题空间,从而提高了整体鲁棒性和搜索性能。

与 CEC2022 前四名算法的比较(相同 FEs 下)

为了进一步评估 MetaDE 的优化能力,我们在相同的函数评估预算内将其与 CEC2022 竞赛的前四名算法进行了比较:

- EA4eig:一种集成多种 EA 的混合方法

- NL-SHADE-LBC:一种改进的自适应 DE

- NL-SHADE-RSP-MID:一种带有中点估计的增强型 SHADE

- S-LSHADE-DP:一种通过动态扰动保持种群多样性的 DE 变体

这些算法均使用其官方参数设置和源代码在相同的 FE 约束下运行。我们在 CEC2022 测试套件上对 MetaDE 和每个基线算法进行了统计比较(Wilcoxon 秩和检验,显著性水平 0.05)。

表格的最后一行显示了各算法在不同测试函数上与 MetaDE 相比的性能:+(显著更好),≈(无显著差异),和 −(显著更差)。

10D CEC2022 竞赛算法比较(相同 FEs)

20D CEC2022 竞赛算法比较(相同 FEs)

MetaDE 始终表现出强大的性能,特别是在需要稳健收敛的复杂问题上。得益于其自适应机制,MetaDE 能针对不同的搜索景观有效地调整策略,从而提高搜索效率和全局优化能力。这些结果表明,MetaDE 不仅优于主流 DE 变体,而且在与顶级竞赛算法的竞争中也表现出强大的竞争力。

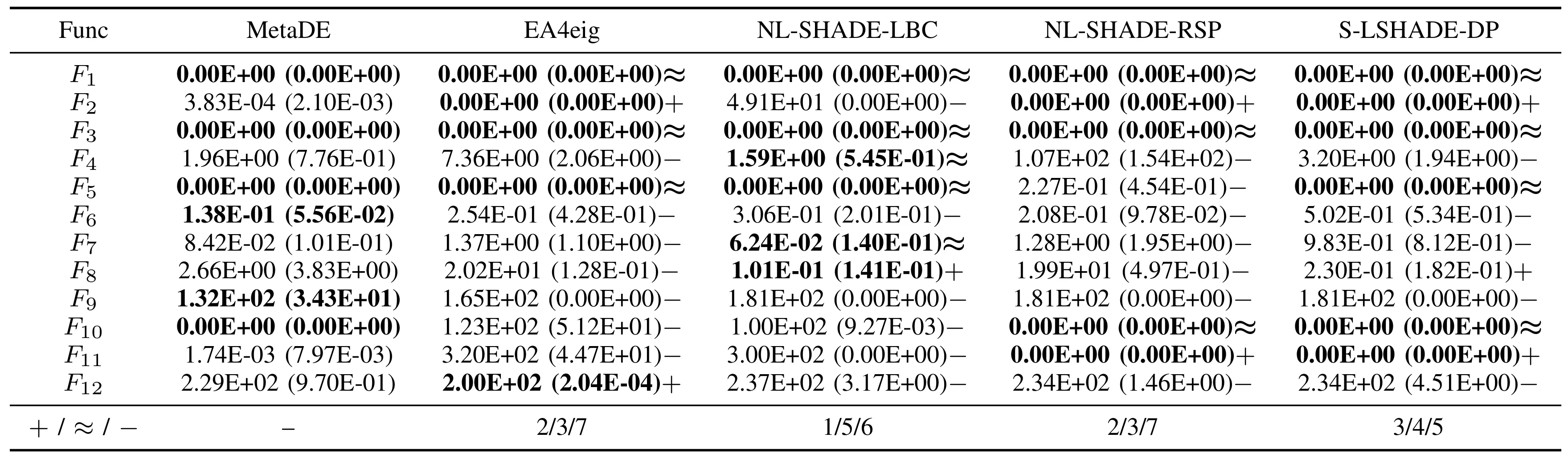

计算效率:固定时间(60 秒)内的 FEs

研究团队进一步记录了不同算法在相同的固定运行时间(60 秒)内完成的函数评估次数(FEs)。

各算法在 60 秒内实现的 FEs在相同的 EvoX 框架下,利用 GPU 加速并行计算,MetaDE 平均达到了 10****⁹ 级别的 FEs,而传统 DE 变体仅达到约 10^6 FEs。这一优势源于 MetaDE 的参数化方法,该方法对个体进行大规模并行评估,从而实现了更高效的硬件资源利用。因此,该算法能在相同的时间窗口内探索更多的解,提高了解决方案的质量和稳定性。

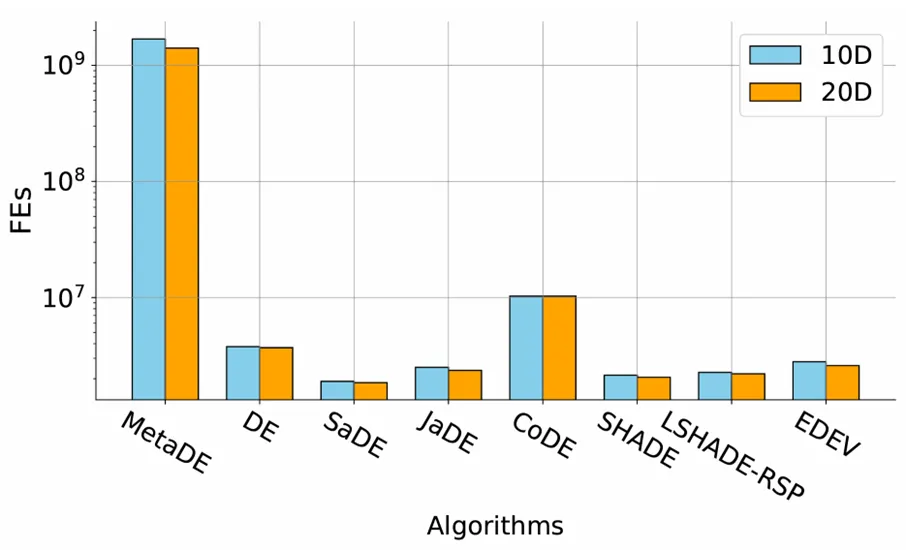

演化强化学习:机器人控制任务

在强化学习(RL)中,策略优化的效率和稳定性至关重要。基于梯度的方法(如 PPO 和 SAC)在高维环境中可能会遇到梯度消失或爆炸的问题。相比之下,演化强化学习(EvoRL)通过使用无梯度搜索直接优化策略参数,规避了这些问题。

演化强化学习过程

在 EvoRL 框架内,MetaDE:

- 自动优化神经网络参数,增加策略模型的适应性。

- 动态调整超参数,提高训练稳定性。

- 利用 GPU 加速来加速策略优化。

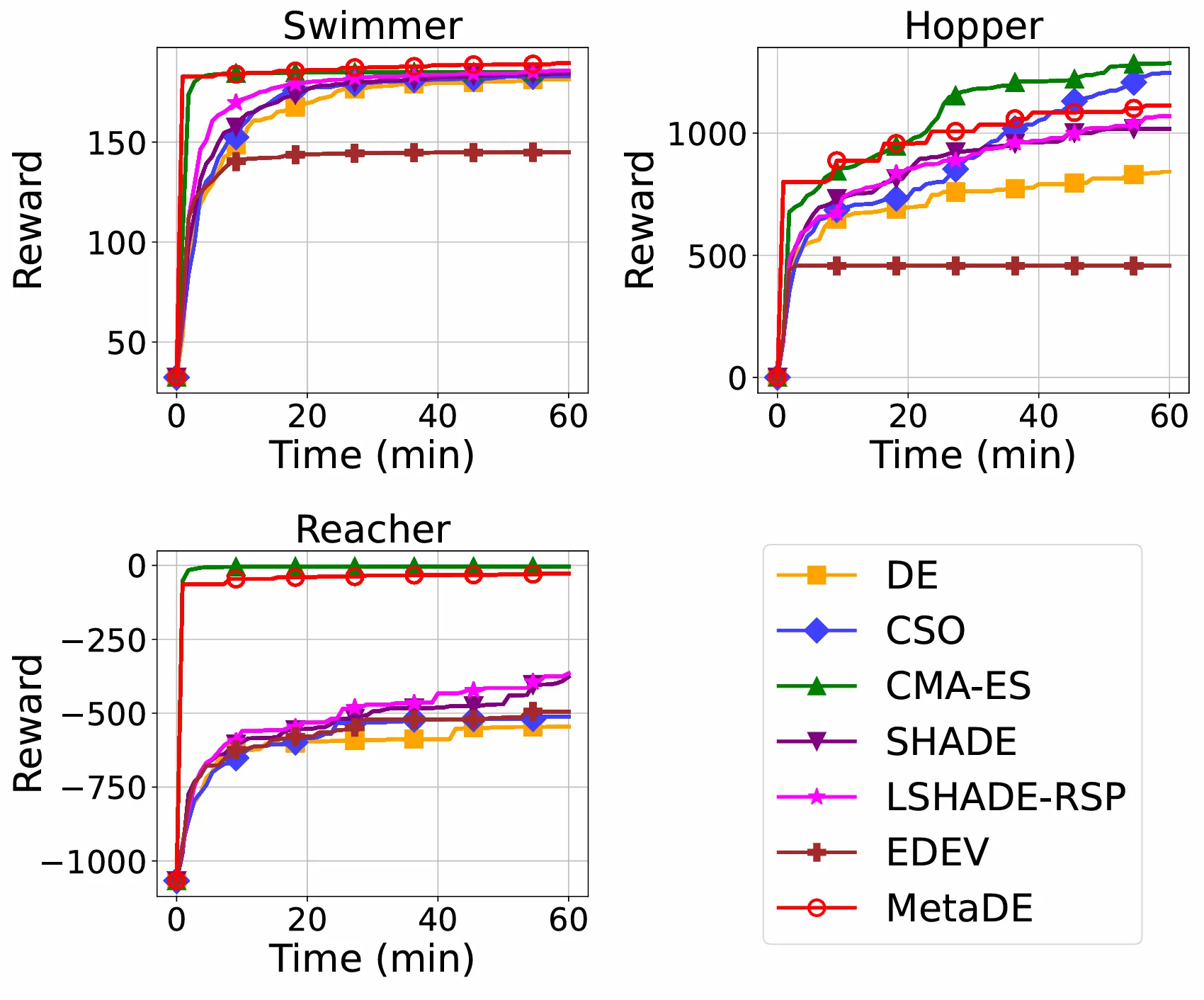

为了评估 MetaDE 在复杂优化任务上的性能,我们在 Brax 仿真平台中使用 GPU 加速优化将其应用于机器人控制问题。研究包括三个任务——Swimmer、Hopper 和 Reacher——每个任务都由一个三层全连接神经网络(MLP)建模,目标是最大化奖励。值得注意的是,每个 MLP 包含约 1,500 个参数,这为演化算法(EAs)带来了一个 1,500 维的优化挑战。这对搜索能力和计算效率都提出了严格的要求。

三个 Brax 环境的收敛曲线

如图所示,MetaDE 在基于 Brax 的机器人控制任务中表现出强大的性能,在 Swimmer 任务上取得了最佳结果,在 Hopper 和 Reacher 上取得了接近最优的结果。其主要优势在于初始种群的高质量,能够实现快速的早期收敛并产生高质量的解。这些发现表明,MetaDE 可以高效地优化神经网络策略,使其非常适合具有复杂物理仿真的机器人控制任务,并具有广泛的实际应用潜力。

结论与未来方向

MetaDE 是一种创新的元演化方法,不仅在解决优化任务方面表现出色,还能自主调整和完善其自身的策略。利用差分进化的优势,MetaDE 在自适应参数配置和策略演化方面展现出强大的潜力。实验结果显示其在一系列基准测试中具有卓越的鲁棒性,其在现实世界中的适用性也通过演化强化学习在机器人控制任务中的成功得到了强调。一个核心挑战在于保持泛化与专用之间的最佳平衡——确保算法既能适应多样化的任务,又能针对特定问题进行有效优化。这项研究为自适应演化算法提供了新的视角,并可能促进复杂系统元演化的进一步发展。

开源代码与社区

论文: https://arxiv.org/abs/2502.10470

GitHub: https://github.com/EMI-Group/metade

上游项目 (EvoX): https://github.com/EMI-Group/evox

QQ 群: 297969717

QQ 群 | 演化机器智能

MetaDE 基于 EvoX 框架构建。如果您对 EvoX 感兴趣,请查看关于 EvoX 1.0 的文章以获取更多详情。

(https://mp.weixin.qq.com/s/uT6qSqiWiqevPRRTAVIusQ)